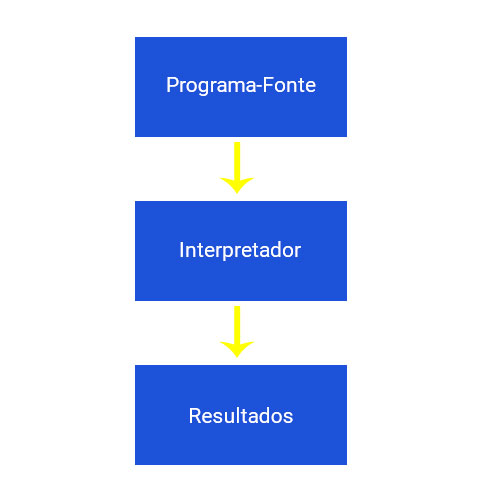

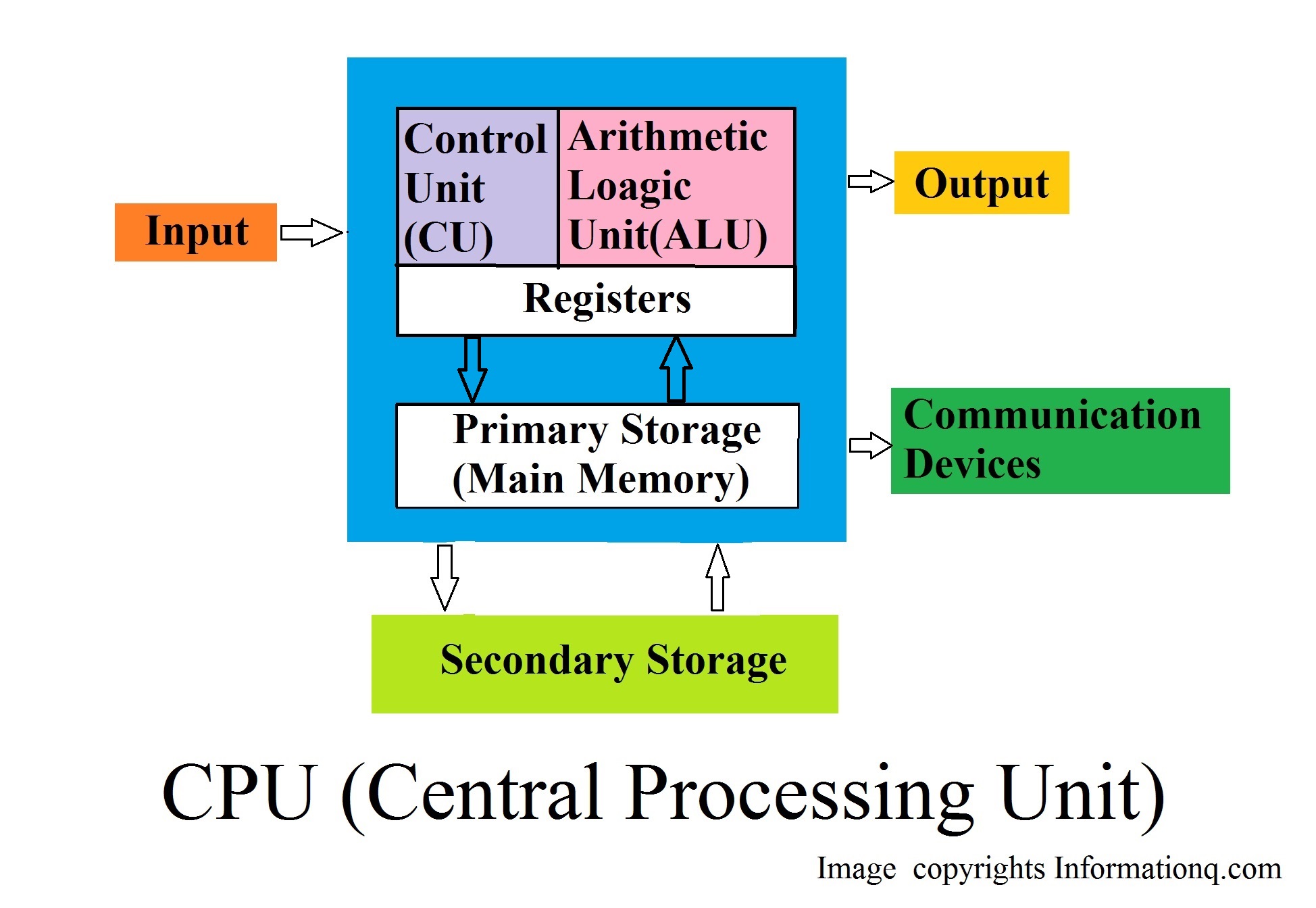

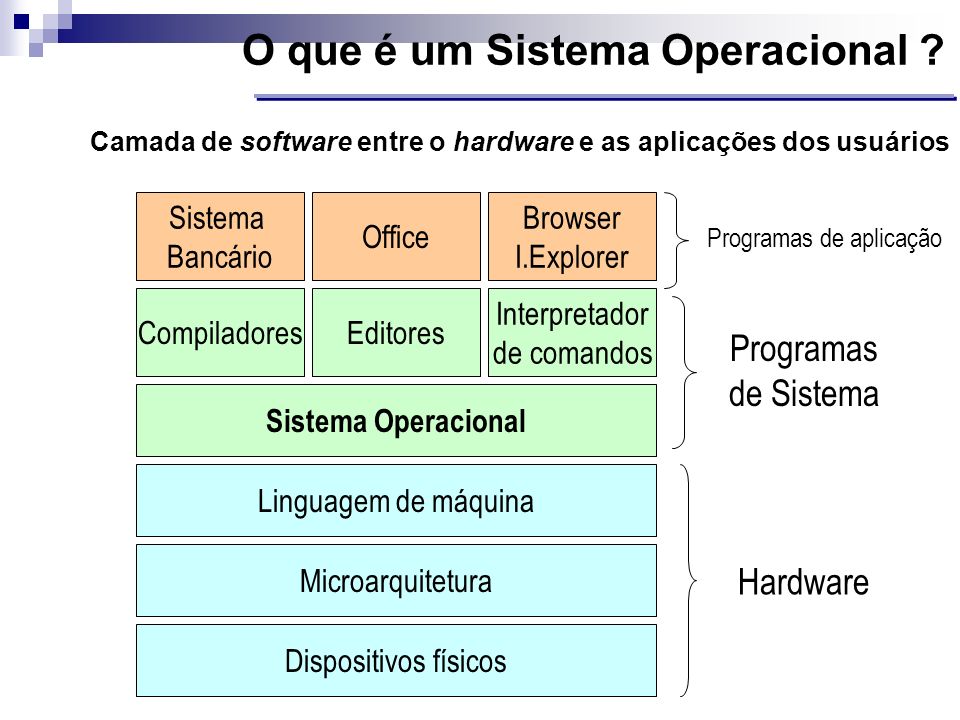

Um SO - sistema operativo (português europeu) ou sistema operacional (português brasileiro) ou os - operating system (inglês) é um programa ou um conjunto de programas cuja função é gerenciar os recursos do sistema (definir qual programa recebe atenção do processador, gerenciar memória, criar um sistema de arquivos, etc.), fornecendo uma interface entre o computador e o usuário (português brasileiro) ou utilizador (português europeu). Sistemas operacionais são programas de controle dos recursos do computador, gerenciando eventuais conflitos, e alocando esses recursos da maneira mais eficiente possível. Constituem assim uma forma razoável de tornar os complexos componentes do hardware em algo utilizável na execução de tarefas para o usuário. O computador (pc - personal computer) é constituído por um conjunto de componentes interligados agrupados em três subsistemas básicos (unidades funcionais): CPU, Memória principal e dispositivos de entrada e saída.

Note

Nesse conteúdo, vamos apresentar tudo sobre sistemas operacionais e arquiteturas de máquinas computadorizadas e vamos relacionar com conceitos e práticas da teoria dos autômatos, circuitos integrados, portas lógicas, sistemas embarcados, engenharia reversa, redes de computadores, linguagem de montagem e compiladores.

Tip

Sistemas operacionais são a ponta do iceberg da área de ciência da computação, envolvendo conceitos, técnicas e algoritmos essenciais para desenvolvimentos de arquiteturas e programas de computador.

Embora possa ser executado imediatamente após a máquina ser ligada, a maioria dos computadores pessoais de hoje o executa através de outro programa armazenado em uma memória não-volátil ROM chamado BIOS num processo chamado "bootstrapping", conceito em inglês usado para designar processos autossustentáveis, ou seja, capazes de prosseguirem sem ajuda externa. Após executar testes e iniciar os componentes da máquina (monitores, discos, etc), o BIOS procura pelo sistema operacional em alguma unidade de armazenamento, geralmente o Disco Rígido, e a partir daí, o sistema operacional "toma" o controle da máquina. O sistema operacional reveza sua execução com a de outros programas, como se estivesse vigiando, controlando e orquestrando todo o processo computacional.

Fundamentalmente, um sistema operacional é um software, que pode ser o Linux, Windows, Android, macOS, UNIX, entre outros. No entanto, ele não resume aquilo que seus olhos conseguem ver ou ao que você consegue interagir. Em outras palavras, é um programa que conversa diretamente com o hardware da sua máquina.computadores na década de 1940. Boole por meio de seus estudos com a matemática desenvolve a álgebra booleana a partir dos números binários, isso possibilitou o avanço dos cálculos computacionais, utilizando inicialmente as válvulas, relays e posteriormente em circuitos integrados. São essenciais na criação de servidores.

-

Possuem a finalidade de tornar os complexos computadores em máquinas convenientes para o usuário;

-

Em máquinas eficientes para a resolução de problemas;

-

Facilitar o acesso aos recursos do computador tornando eficiente o uso do hardware, aumentando a produtividade e agilizando as atividades diárias;

-

Garantir a segurança dos dados e sua integridade tanto no armazenamento quanto durante as atividades de processamento, bem como no acesso aos recursos físicos disponíveis.

Histórico dos Sistemas Operacionais: A evolução dos computadores e sistemas de informação no mundo. Desde cálculos até máquinas convencionais

-

5.500 a.C: Ábaco, a primeira calculadora da História.

-

150 a.C. a 100 a.C.: A Máquina de Anticítera (ou Antikythera, em inglês) é considerada o primeiro computador mecânico da história, construído na Grécia Antiga.

-

1638: Régua de Cálculo.

-

1642: Máquina La Pascaline (Máquina de Pascal), de Blaise Pascal, (calculadora mecânica de adição e subtração, a primeira no mundo);

-

1673: Máquina de Gottfried Leibiniz (máquina de somar e multiplicar);

-

1820: Charles Colmar (máquina com quatro operações);

-

1822: Charles Babbage (máquina de cálculos de equações polinomiais);

-

1833: Babbage (máquina para qualquer tipo de operação, máquina analítica - Analytical Engine)

-

1842: Babbage realizou um seminário sobre sua máquina Analítica, que posteriormente foi publicado em francês, contudo ele solicitou ajuda a Ada Lovelace, "Augusto Ada Byron" foi a 1° programadora da história, para traduzir em inglês e adicionar comentários sobre sua máquina no documento. Ada classificou alfabeticamente seus comentários. A máquina analítica foi reconhecida como o primeiro modelo de máquina programável e os comentários de Ada, como a primeira sequência de instruções ou algoritmo.

-

1854: George Boole - Lógica Booleana (

OR,AND,NOT-True/False) base do modelo de computação digital até hoje. Conceito de lógica binária (relés e válvulas) - computadores na década de 1940. Boole por meio de seus estudos com a matemática desenvolve a álgebra booleana a partir dos números binários, isso possibilitou o avanço dos cálculos computacionais, utilizando inicialmente as válvulas, relays e posteriormente em circuitos integrados. -

1889: O norte-americano Herman Hollerith fundador da Tabulating Machine Company, precursora da International Business Machine (IBM), e o engenheiro mecânico francês Joseph Marie Jacquard desenvolveram cartões perfurados, esses cartões guardavam informações e comandos nas máquinas.

-

1935-1938: 1° computador eletromecânico a utilizar binário foi o modelo Z1 criado pelo engenheiro alemão Konrad Zure entre 1935 e 1938 durante a Segunda Guerra, o computador trabalhava com lógica booleana utilizando um sistema de relays.

-

1937: Na universidade de Harvard foi projetado o Automatic Sequence Controlled Calculator (ASCC), um computador capaz de executar as quatro operações fundamentais de aritmética, logaritmos, potenciação, razão de seno e raiz quadrada com autoria do físico Howard Aiken.

-

1939: Segunda Guerra Mundial (Aliados x Eixo). Nesse tempo, a informática teve um papel fundamental, os computadores foram desenvolvidos para calcular estratégias, e descriptografar mensagens dos inimigos mais rápidos que o ser humano.

-

1941: Modelo Z3 e Bombe; A Bombe (Bomba eletromecânica) foi feita para decifrar as mensagens nazistas baseadas em uma linguagem de símbolos Enigma. O Bombe britânico foi concebido pelo engenheiro Harold Keen e Alan Turing da BTMC (British Tabulating Machine Company).

-

1943-1945: Colossus, computador usado para decriptografar os complexos símbolos de Lorenz S2-40 utilizado pelos nazistas, ele era um computador que utilizava em média 2500 válvulas para computar lógica booleana, sendo o primeiro computador eletrônico digital programável.

-

1943-1945: O computador Eletronic Numeral Integrator and Computer (ENIAC) feito por John Mauchly e J Presper Eckert na Escola Moore, foi desenvolvido com tecnologia eletrônica, mil vezes mais rápida que a eletromecânica. Usou fiação de válvulas termiônicas (ou válvulas eletrônicas), que substituíam os relés eletromecânicos usados em máquinas anteriores. Essas válvulas permitiam a amplificação e comutação de sinais eletrônicos, o que fez com que o ENIAC fosse cerca de mil vezes mais rápido do que os computadores eletromecânicos da época.

-

1959: Guerra fria, após o fim da Segunda Guerra Mundial, novas tecnologias foram criadas, como a Memória RAM, UNIVAC I, silício para criação de semicondutores, discos rígidos, linguagem FORTRAN. Depois dos eventos da Mark I e II, Grace Hopper, matemática da Marinha dos Estados Unidos, começou a trabalhar para a corporação Eckert Mauchly Computer, como matemática sênior e gerenciou a equipe de desenvolvimento do UNIVAC I que foi o primeiro computador que atendeu o mercado industrial, sua estrutura robusta com 5 mil válvulas em operação e pesando aproximadamente 13 toneladas. Criou seu primeiro compilador, o A-O e as primeiras linguagens baseadas em compiladores como o Math-Matic e Flow-Matic, que foram utilizadas na UNIVAC I e também trabalhou no desenvolvimento da linguagem de programação COBOL.

-

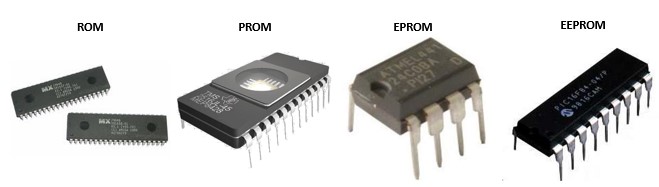

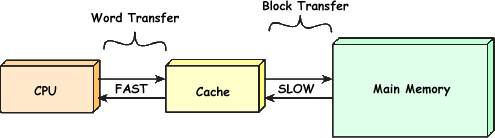

Década de 50: Primeiras linguagens de programação: Assembly, Fortran, Algol, Cobol, Evolução dos SOs, incorporam seu próprio conjunto de rotinas para operação de I/O (IOCS), Sistema Operacional Atlas - introduziu a ideia de memória hierarquizada, base do conceito de memória virtual.

-

Década de 60: Circuitos integrados, custo menor de aquisição - difusão do uso de sistemas computacionais em empresas. Substituição de fitas por discos no processo de submissão dos programas juntamente com a multiprogramação, tornou sistemas mais rápidos e eficientes.

-

Década de 70: Nos anos 70, mais especificadamente em 1970, os computadores com memória virtual e com 32 bits foram criados; Em 1971, Intel Corp - seu 1° microprocessador - Intel 4004; Em 1974, Intel Corp - microprocessador Intel 8080 - utilizado no 1° microcomputador - Altair; Em 1976, Steve Jobs e Steve Wozniak produzem o Apple II e 8 bits; 1976, Apple e Microsoft são fundadas o SO dominante é o CP/M da Digital Research; Surge o multiprocessamento nos SO, possibilitando de execução de mais de um programa simultaneamente ou até de um programa por mais de um processador. WANs e LANs são definidas, marco do surgimento dos protocolos de redes de computadores. Os SOs passam a estar intimamente relacionados aos softwares de rede; 1971, Niklaus Wirth desenvolve a linguagem Pascal. 1975, Dennis Ritchie desenvolve a linguagem C e juntamente com Ken Thompson, porta o UNIX para um PDP-11, concebido inicialmente em Assembly.

-

Década de 80: Nos anos 80, em 1981, IBM PC com processador Intel 8088 de 16bits e sistema operacional DOS da Microsoft; Universidade de Berkley desenvolve uma versão do UNIX (Berkley Software Distribution - BSD) e introduziu o protocolo TCP/IP; Evolução da família Intel e surgimento dos primeiros sistemas operacionais gráficos como Windows e OS/2; Surgimento de sistemas operacionais de rede como Novell Netware e Microsoft LAN Manager; A computação quântica começou a tomar forma como campo de estudo na década de 1980, quando cientistas começaram a explorar como os princípios da mecânica quântica poderiam ser aplicados à computação.

-

Década de 90: Nos anos 90, evolução da microeletrônica - desenvolvimento de processadores e memórias mais velozes e baratos, dispositivos de I/O menores, mais rápidos e mais capacidade; Com o advento da Internet e o protocolo TCP/IP, torna-se padrão de mercado e problemas de gerência, segurança e desempenho tornam-se fatores importantes relacionados a SO e à rede; Consolidação de SO com interfaces gráficas (GUI); 1991, Linus Torvalds inicia o Linux e evolui com a colaboração de vários programadores (Kernel, utilitários e aplicativos); 1993, Microsoft lança o Windows NT; Nesta década o Windows e o Unix (HP-UX, IBM-AIX e Sun Solaris) consolidam-se como sistemas corporativos.

-

2000: Nos anos 2000, os sistemas operacionais tornam-se cada vez mais intuitivos e passam a ser proativos, isto é, passam a incorporar mecanismos automáticos de detecção e recuperação de erros; Surgimento do REST API; Sistemas em Cluster; Processamento distribuído; Evolução de redes sem fio (Wi-Fi Wireless) - SO Embarcados em dispositivos como celulares, handhelds e palmtops; A Microsoft unifica suas duas versões e inclui novos recursos tanto para servidores quanto para PCs - Windows 2000 e Windows XP, lançados no início da década, evoluíram para 2003 e Vista; O Linux evolui para tornar-se o padrão de SO de baixo custo, com inúmeras formas de distribuições; Processadores 64 bits; Surgimento de softwares que permitem a virtualização de máquinas; Lançamento do Windows 2008 e do Windows 7, plataformas da Microsoft para servidor e computador pessoal, respectivamente, em substituição de suas versões anteriores (2003 e XP); Windows 2008 com virtualização de servidores nativo no sistema operacional, denominado Hyper-V.

-

2025: O primeiro computador biológico de uso comercial do mundo foi lançado pela startup australiana Cortical Labs durante a Mobile World Congress (MCW);

-

Atualmente:

As arquiteturas de hardware juntamente com a evolução dos SOs:

1° Geração (1945 - 1955): Completo acesso ao hardware; Instruções eram introduzidas manualmente, uma a uma, em linguagem de máquina, não existindo, portanto, o conceito de Sistema Operacional; ENIAC, 1943-1946, criado por Eckert, Mauchy e Presper na Pensilvânia, que era um computador que empregava 18.000 válvulas e relés.

Nas primeiras máquinas, a introdução das instruções era por meio de chaveamento de circuitos através de cabos, como nas mesas telefônicas mais antigas.

2° Geração (1955 - 1965): O desenvolvimento do transistor, seu emprego na construção de computadores tornou-os mais baratos e permitiu seu uso comercial. Linguagem de programação de alto-nível, Fortran, e foi desenvolvido o sistema de processamento em batch (lote). A cada lote a ser processado era denominado job, e os sistemas operacionais eram projetados para permitir transição mais fácil entre eles. Quando em execução, um job detinha todo o controle da máquina. Após seu encerramento, o controle era retornado ao SO que procedia a um "clear" total e executava a leitura do próximo job; IBM 701; Para executar uma atividade, o usuário utilizava um formulário de programação, escrevia o seu programa e a seguir, utilizando uma máquina perfuradora, transformava em um conjunto de cartões. IBM 701, para executar uma atividade, o usuário utilizava um formulário de programação, escrevia o seu programa e a seguir, utilizando uma máquina perfuradora, transformava em um conjunto de cartões. Em seguida, os operadores carregavam os cartões perfurados em leitores que os transferiam para fitas magnéticas. As fitas, então, eram lidas pelo computador, que executava um programa por vez, gravando o resultado em uma fita.

Finalmente, a partir do conteúdo da fita era gerado um relatório impressão a ser entregue ao usuário que solicitou o processamento.

3° Geração (1965-1980): esta geração marca o surgimento dos circuitos integrados e da multiprogramação. Ocorreu, em 1965, a introdução no mercado das máquinas IBM/360. Essa geração caracterizou-se pelo surgimento dos sistemas de propósito geral e dos sistemas multimodo. Os computadores desta geração se tornaram mais baratos e rápidos suportando ao mesmo tempo o processamento em lotes, multiprocessamento com atendimento de terminais interativos e também, aplicações de tempo real. Foi desenvolvido nesta época, também, o Sistema Operacional UNIX.

Técnicas desses SOs:

-

Alocação de memória: A memória do sistema é dividida em várias partições nas quais diferentes programas eram carregados de forma que vários deles pudessem utilizá-la de forma concorrente;

-

Spooling: enquanto um job (tarefa) era executado, os cartões de outros jobs eram lidos e transferidos para o disco. Isso permitia que a troca entre os diversos jobs ocorresse de forma mais rápida, já que o acesso ao disco era muito mais rápido que a leitura dos cartões;

-

Time sharing: cada programa, na memória, utilizava o processador em pequenos intervalos de tempo, isso permitia que, enquanto uma tarefa esperava alguma operação de Entrada ou Saída, outra utilizasse o processador (CPU).

4° Geração (1980 até Hoje): Surgimento da integração em larga escala e dos computadores pessoais. A integração em larga escala permitiu que a CPU do computador fosse construída em um único chip de silício barateando o seu custo e permitindo o surgimento dos computadores pessoais. O surgimento dos microcomputadores levou à criação de toda uma nova geração de SOs. Como então qualquer pessoa poderia ter um computador, o SO teve que se adaptar, fornecendo mais interatividade, evoluindo das interfaces, em texto, como o DOS para as interfaces gráficas como o Windows.

O sistema operacional proporciona o ambiente no qual os programas são executados e é composto por um conjunto de rotinas, conhecido como o núcleo (kernel). O Kernel padrão, é chamado de kernel monolítico , nele o sistema operacional é escrito como uma coleção de rotinas, ligadas a um único grande programa binário executável. O kernel monolítico executa cada serviço do sistema como gerenciamento de memória, manipulação de interrupções e comunicação I/O, sistemas de arquivos, no espaço do kernel.

Temos também o microkernel que é uma abordagem de arquitetura de sistemas operacionais onde apenas os componentes essenciais do sistema rodam no kernel — como a comunicação entre processos, gerenciamento de memória e controle de hardware básico. Tudo o mais, como drivers de dispositivos, sistemas de arquivos e até a pilha de rede, é mantido fora do kernel, operando em espaço de usuário como serviços separados.

O conceito do microkernel é de reduzir o kernel a comunicação de processos básicos e o controle de I/O, e deixar os outros serviços de sistemas situados no user-space (espaços de usuário) em forma de processos normais (chamados de servers).

Isso traz algumas vantagens:

- Mais estabilidade e segurança, porque um erro em um componente fora do núcleo tem menos chance de derrubar o sistema inteiro.

- Maior modularidade, facilitando atualizações e manutenção.

- Portabilidade, já que o microkernel é pequeno e mais fácil de adaptar a diferentes arquiteturas.

No entanto, ele também pode ser mais lento em certas operações, pois exige mais trocas de contexto entre o núcleo e os serviços no espaço do usuário.

Ele é aplicado principalmente em:

- Sistemas embarcados, como dispositivos médicos, automóveis e aviônicos, onde confiabilidade é crucial.

- Sistemas que exigem alto grau de segurança, como projetos militares e governamentais.

- Alguns projetos acadêmicos e de pesquisa também gostam de explorar microkernels como forma de experimentar novas ideias de sistema operacional.

Um bom exemplo real é o seL4, um microkernel focado em segurança formalmente verificada.

A interface entre o Sistema Operacional e os programas dos usuários é definida por um conjunto de instruções denominado chamadas de sistema (System Calls). As system calls constituem a interface entre um programa do usuário e o Sistema Operacional. Elas podem ser entendidas como uma porta de entrada de acesso ao núcleo do sistema, que contém suas funções. Sempre que o usuário necessitar de algum serviço, solicita-o através de uma chamada de sistema definida e específica.

Os tipos de sistemas operacionais são classificados como: Sistemas monoprogramáveis ou monotarefas, sistemas multiprogramáveis ou multitarefas e sistemas multiprocessadores.

Sistema monoprogramado ou monotarefa o sistema computacional fica totalmente dedicado a um único programa, ou seja, todos os recursos e dispositivos ficam o tempo todo disponíveis ao programa que está sendo executado, mesmo que o dispositivo não esteja sendo utilizado. Por exemplo, se o programa está fazendo uma operação de entrada e saída o processador, apesar de ocioso, não pode ser utilizado para outra tarefa.

Características:

- Esta era a configuração típica dos primeiros SO;

- Este tipo de SO pode atender a apenas um único usuário de cada vez;

- Este tipo de SO é relativamente simples de ser implementado.

Inicialmente, os SO eram monotarefas, ou seja, apenas uma tarefa (programa) era executada de cada vez. Com a evolução dos sistemas computacionais, os SOs também evoluíram no sentido de dar suporte à execução de várias tarefas ao mesmo tempo, de forma real em sistemas com múltiplos processadores, ou de forma concorrente em sistemas com um único processador, por meio de multiprogramação. Para dar conta dessa situação, os projetistas de Sistemas Operacionais desenvolveram o conceito de processo.

Para que a execução de várias tarefas seja possível, é necessário o monitoramento das múltiplas atividades entre os vários programas, tarefa difícil e bastante complexa.

Sistema multiprogramado ou multitarefa são os mais complexos que os sistemas monoprogramáveis, os diversos recursos computacionais são compartilhados pelas várias tarefas ou programas, a execução concorrente de processos. Neste tipo, o SO deve gerenciar a alocação dinâmica dos recursos do computador às diversas demandas geradas pelas tarefas. Todo SO multiusuário é ao mesmo tempo um sistema multitarefa.

O SO terá que gerenciar o acesso concorrente aos componentes do sistema, protegendo os dados de cada programa e evitando que as ações de uma tarefa prejudique as outras. Este tipo de SO aumenta a produtividade e reduz os custos de utilização, pois enquanto um programa realiza uma operação de entrada e saída outro pode utilizar o processador.

Quanto ao suporte aos usuários, pode ser classificado como:

-

Monousuário apenas um usuário utiliza o sistema por vez.

-

Multiusuário vários usuários podem executar o sistema ao mesmo tempo.

Sistemas desse tipo podem suportar várias formas de processamento:

-

Sistemas Batch: como os utilizados na segunda geração de computadores. Este tipo não necessita da interação do usuário, já que o programa é executado sequencialmente após a sua carga que era realizada a partir de fitas ou discos.

-

Sistemas de tempo compartilhado (time sharing): O tempo de uso do processador é dividido em pequenas fatias atribuídas a cada programa, permitindo assim que diversas tarefas sejam executadas. O usuário tem a impressão de que o sistema está todo dedicado ao seu trabalho e desta forma o SO permite que vários usuários o utilizem ao "mesmo tempo". Um sistema operacional que trabalha com multiprogramação é classificado como sistema de tempo compartilhado.

-

Sistemas de tempo real: Diferem dos sistemas de tempo compartilhado por suas aplicações possuírem um tempo máximo aceitável para produzir a resposta.

Sistemas multiprocessados caracterizam-se por possuírem vários processadores que trabalham em conjunto e compartilham dados. Desta forma, permitem que vários programas sejam, verdadeiramente, executados simultaneamente, sendo assim multiusuários.

Este tipo de sistema, além dos benefícios da multiprogramação, possui outras vantagens específicas como:

-

Estabilidade: Ampliar a capacidade computacional acrescentando mais processadores.

-

Disponibilidade: Se um processador falhar os outros podem manter o sistema ativo.

-

Balanceamento de carga: Distribuir as tarefas entre os varios processadores a partir da carga de trabalho de cargo um, ocupando a capacidade ociosa e melhorando o desempenho total do sistema.

Podem ser:

-

Fortemente acoplados: os sistemas multiprocessados compartilham uma única memória e são controlados pelo mesmo SO. Como por exemplo, podemos citar modelos de modernos PCs com vários chips de processadores ou os chips com vários nucleos como os I3, I5 e I7 da Intel.

-

Fracamente acoplados: os processadores não estão em um único computador, mas espelhados em máquinas diferentes, cada uma com o seu SO. Estes computadores são ligados por uma linha de comunicação. Como exemplo, temos os servidores e os clientes de uma rede de computadores. Exemplos deste tipo são os Sistemas Operacionais de Redes e os Sistemas distribuídos.

Portanto, para criar um sistema operacional do zero — partindo do zero mesmo, como no estilo dos kernels tipo Unix, Linux, Minix, ou mesmo kernels experimentais — é necessário, sim, ter domínio de praticamente toda essa base descrita. Isso porque um sistema operacional é o elo direto entre o hardware cru e os softwares que rodam sobre ele. Ele gerencia a CPU, memória, dispositivos de E/S, processos, arquivos e até redes — tudo isso exigindo conhecimento profundo de múltiplas camadas da computação.

Começando por arquitetura de computadores, você precisa entender como o processador funciona, como ele lê instruções, acessa a memória, manipula interrupções e executa código binário. Sem isso, não há como escrever o bootloader ou um kernel funcional. A linguagem de montagem (Assembly) entra nesse ponto como ferramenta obrigatória para inicializar o processador, configurar registradores, pilha e chamar instruções específicas antes de passar o controle para algo em C ou C++.

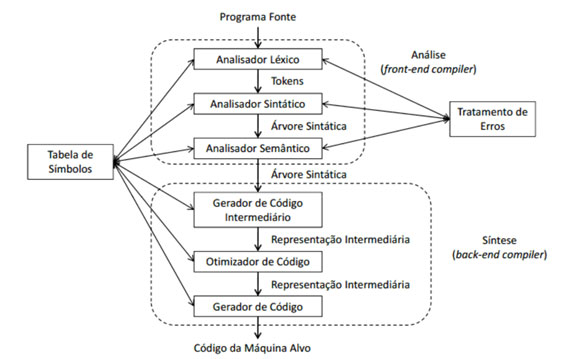

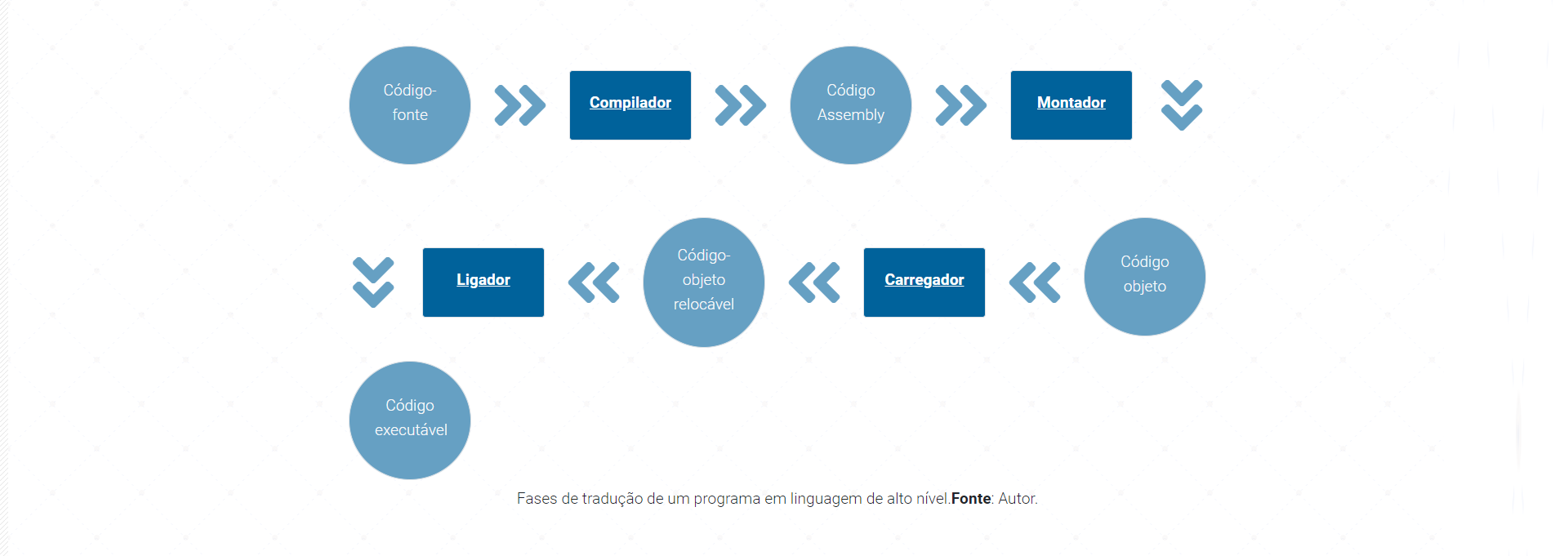

A seguir, entram os conceitos de compiladores e linkers: você precisa saber como seu código será traduzido para binário, como o loader irá interpretá-lo, e como o SO vai organizar símbolos, tabelas e chamadas. Esse conhecimento é fundamental até para construir um simples carregador de arquivos .elf ou lidar com o layout da memória no tempo de boot.

Teoria dos autômatos, embora pareça distante, é essencial nos bastidores: os conceitos de máquina de estados, análise léxica e sintática são usados em shells, interpretadores, gerenciadores de tarefas, sistemas de arquivos e até em drivers que interagem com hardware de forma controlada.

Portas lógicas e circuitos integrados te conectam ao nível elétrico da computação. Embora você não vá soldar chips ao criar um SO, entender como bits são representados fisicamente, como interrupções são geradas eletricamente e como o processador interage com a memória e com o barramento é indispensável para entender, por exemplo, o mapeamento de memória, o acesso direto à hardware (como VGA, UART) ou o uso de I/O-mapped devices.

Sistemas embarcados são praticamente sistemas operacionais minimalistas em si. Criar um SO para embarcados exige, além da base tradicional, conhecimento sobre gerenciamento de energia, controle em tempo real, escalonamento determinístico e drivers com restrições de espaço, RAM e processamento.

Engenharia reversa não é usada para criar do zero, mas ajuda imensamente a aprender com quem já criou. Você pode estudar kernels como o Linux, OpenBSD ou projetos como os kernels experimentais do GitHub para ver como o boot, o gerenciamento de processos, a organização da memória virtual e a pilha de rede foram implementados. Muitos aprendem a escrever SOs justamente desmontando outros.

Por fim, redes de computadores entram como uma das funcionalidades mais avançadas. Para um SO se comunicar, ele precisa de uma pilha de rede própria, que lida com pacotes, buffers, protocolos e drivers de interface. Implementar isso requer não só domínio de protocolos como TCP/IP, mas também acesso baixo nível ao hardware da placa de rede.

Então sim — a interligação de todos esses campos é praticamente obrigatória para construir um sistema operacional real, mesmo que mínimo. Claro que você pode começar pequeno: um bootloader que imprime uma mensagem na tela, depois um scheduler simples, depois um gerenciador de memória rudimentar... Mas com o tempo, todos esses domínios se entrelaçam. Você não precisa dominar tudo de cara, mas sim entender que criar um SO exige conhecimento que atravessa toda a base estrutural da ciência da computação.

Um programa é um conjunto de instruções, também conhecidas como algoritmos, que descrevem uma tarefa a ser realizada por um computador. O termo pode ser uma referência ao código fonte, escrito em alguma linguagem de programação, ou ao arquivo que contém a forma executável deste código fonte. Um programa torna um computador utilizável, sem ele um computador, mesmo o mais poderoso, nada mais é do que um objeto.

Os computadores são capazes de executar tarefas muito complexas, mas essa capacidade não lhes é inata. A natureza de um computador é bastante diferente. Ele só pode executar operações extremamente simples, por exemplo, um computador não pode avaliar o valor de uma função matemática complicada por si só, embora isto não esteja fora do âmbito das possibilidades num futuro próximo.

Os computadores contemporâneos só podem avaliar os resultados de operações muito fundamentais, como adicionar ou dividir, mas podem fazê-lo muito rapidamente, e podem repetir estas ações virtualmente um qualquer número de vezes.

As Lógica de programação é a habilidade de organizar pensamentos computacionais, habilidades técnicas e pessoais (Hard e Soft Skills) e instruções de forma lógica e estruturada, essencial para resolver problemas e criar algoritmos que possam ser entendidos e executados por um computador. É como construir um mapa claro e sequencial de passos para atingir um objetivo, usando raciocínio lógico, condicionais, loops e operações para criar um conjunto de instruções compreensível e eficiente para resolver um problema computacional.

Há uma relação entre a lógica de programação e as regras de negócio. A lógica de programação é fundamental para traduzir as regras de negócio em instruções lógicas e algoritmos compreensíveis para o computador. As regras de negócio representam as diretrizes, restrições e condições que definem como um negócio deve operar, incluindo políticas, procedimentos, metodologias, processos, contratos e operações específicas. A lógica de programação ajuda a implementar essas regras de negócio no código, permitindo que os desenvolvedores convertam os requisitos e as lógicas do mundo real em algoritmos que o computador possa entender e executar. Isso envolve a criação de estruturas condicionais, loops, operações lógicas e matemáticas que representam fielmente as regras de negócio.

Assim, a habilidade de compreender as regras de negócio e traduzi-las adequadamente para o código por meio da lógica de programação é crucial para o desenvolvimento de sistemas de software que atendam às necessidades e expectativas de uma empresa ou projeto.

Os algoritmos são um conjunto de instruções ou regras bem definidas, que são usadas para resolver um problema ou realizar uma tarefa. Eles são usados na ciência da computação para descrever a sequência de passos que um computador deve seguir para realizar uma determinada operação, como realizar um cálculo matemático, ordenar uma lista de dados, realizar uma pesquisa na internet, consultar dados, criar interfaces ou construir uma API. Então, um algoritmo é um conjunto de instruções, passos ou regras bem definidas e finitas, que quando são estruturados e organizados são usados para resolver um determinado problema ou realizar uma tarefa computacional de qualquer nível de complexidade, dependendo das situações que o dispositivo operar e corresponder a elas. E, portanto, o esboço de um algoritmo é gerado através de um pensamento computacional, organização de ideias, prototipagem/documentação, processos de entrega (DevSecOps), sistema de controle de versões e lógica matemática. Tudo vem na mente para depois ser escrito no papel e depois na máquina com regras de input (entrada) e output (saída) para compilação ou interpretação da máquina.

O pensamento computacional é o processo de pensamento envolvido na formulação de um problema e na expressão de sua solução de forma que um computador humano ou máquina possa efetivamente realizar.

Os algoritmos são usados em muitas áreas diferentes, incluindo ciência da computação, matemática, engenharia, física e biologia. Eles são a base para muitos programas de computador e sistemas automatizados, e são essenciais para muitas tarefas complexas que requerem uma sequência de operações precisas. Algoritmos também são usados em inteligência artificial e aprendizado de máquina, onde são usados para ensinar computadores a aprender e tomar decisões com base em dados.

Podemos dizer que Algoritmos é o "ABC", ou seja a base, da área de ciência da computação que todo desenvolvedor de software deveria saber antes de desenvolver sistemas complexos.

Um software é um conjunto integrado de programas de computador. Um programa de computador é um conjunto de instruções que descreve, passo a passo, uma tarefa que deve ser realizada pelo hardware.

Exemplo: Software de Gestão Escolar = conjunto de programas que executam um conjunto de tarefas necessárias a gestão de uma escola. Dentro do Software de Gestão Escolar, temos o programa que calcula a média dos alunos, com base nas notas informadas das provas.

Para o desenvolvimento dos programas que integram o software precisamos de uma linguagem de programação, que define as instruções e a forma de relacioná-las.

A primeira linguagem de programação gerava programas, em código de máquina (sequência de 0 e 1), mas era muito difícil para o programador que teria que escrever um código binário (0 ou 1), memorizar as instruções em sequencias de 0 e 1.

A partir daí, diferentes linguagens de programação foram criadas, sempre almejando conceder poder e facilidade ao programador. Eram as linguagens de programação de alto nível (receberam esse nome por serem bem próximas da linguagem natural do homem).

Mas o Hardware somente entende a linguagem binária, assim sendo, o programa escrito em linguagem de alto nível precisa passar por um processo adicional, que converta a linguagem de alto nível em linguagem de máquina para ser compreendida e executada pelo hardware.

Vamos ver agora exemplos de algoritmos abaixo:

Exemplo 1: Somando dois números

- Digite o primeiro número:

- Digite o segundo número:

- Some os dois números escolhidos.

- Exiba o resultado da soma:

Exemplo 2: Atravessar a rua

- Encontre uma faixa de pedestres ou uma interseção controlada por semáforo.

- Pare na calçada e aguarde a luz verde do semáforo de pedestres ou o sinal de pedestre indicando que é seguro atravessar.

- Olhe para a esquerda, para a direita e depois para a esquerda novamente para garantir que nenhum veículo esteja se aproximando.

- Comece a atravessar a rua, mantendo-se na faixa de pedestres e continue a olhar para a esquerda e para a direita enquanto atravessa.

Exemplo 3: Cubo Mágico

Resolver o cubo mágico é um desafio emocionante que pode ser alcançado com a prática e o uso de algoritmos adequados. Com a estratégia certa e a persistência, qualquer pessoa pode dominar a arte da resolução do cubo mágico.

Existem várias maneiras de resolver o cubo mágico, mas o método mais comum é o método Camadas, usando algoritmos que envolve a resolução do cubo em camadas, uma por vez.

A lógica de programação é essencial para um desenvolvedor, imagine que quer saber a velocidade média que alcançou durante uma longa viagem. Sabe a distância, sabe o tempo, precisa da velocidade. Naturalmente, o computador será capaz de calcular isto, mas o computador não está ciente de coisas como distância, velocidade ou tempo. Portanto, é necessário instruir o computador a:

- Aceitar um número que represente a distância;

- Aceitar um número que represente o tempo de viagem;

- Dividir o valor anterior pelo último e armazenar o resultado na memória;

- Exibir o resultado (representando a velocidade média) num formato legível.

Estas quatro simples ações formam um programa. É claro que estes exemplos não são formalizados, e estão muito longe do que o computador pode compreender, mas são suficientemente bons para serem traduzidos para uma linguagem que o computador possa aceitar.

Uma Linguagem (Language), nossa palavra-chave, é um meio (e uma ferramenta) para expressar e registar pensamentos. Há muitas linguagens ao nosso redor e algumas delas não requerem nem a fala nem a escrita, como a linguagem corporal; é possível expressar os seus sentimentos mais profundos com muita precisão sem dizer uma palavra.

Outra linguagem que usa diariamente é a sua língua materna, que usa para manifestar a sua vontade e para pensar na realidade. Os computadores também têm a sua própria linguagem, chamada linguagem de máquina, que é muito rudimentar. O código de máquina ou linguagem de máquina é uma linguagem de programação de baixo nível, constituída por dígitos/bits binários que o computador lê e compreende, ou seja, é um conjunto de instruções executadas diretamente pela unidade de processamento central (CPU) de um computador. Cada instrução executa uma tarefa muito específica, como uma carga, um salto ou uma operação ALU em uma unidade de dados em um registrador ou memória da CPU. Todo programa executado diretamente por uma CPU é composto por uma série de tais instruções. O código de máquina numérico pode ser considerado como a representação de nível ainda mais baixo de um programa de computador compilado e/ou montado ou como uma linguagem de programação primitiva e dependente de hardware. Embora seja possível escrever programas diretamente em código de máquina numérico, é tedioso e propenso a erros gerenciar bits individuais e calcular endereços numéricos e constantes manualmente. Portanto, raramente é feito hoje, exceto em situações que exigem otimização ou depuração extremas.

Note

O código de máquina numérico (machine code) não é o código ou linguagem de montagem, conhecida como Assembly ou Assembler, cujo é uma linguagem de programação de baixo-nível superior.

010010101010010

010010100110100

010101100111010

010101010101011

010101010100101

010101010010111

Note

As linguagens de máquina são desenvolvidas por humanos e não pela própria máquina.

Um computador, mesmo o mais sofisticado tecnicamente, é desprovido até mesmo de um vestígio de inteligência. Esse é um assunto muito abordado quando estudamos para Inteligência Artifical e Machine Learning.

Pode-se dizer que é como um 🐵 macaco bem treinado - responde apenas a um conjunto pré-determinado de comandos conhecidos. Os comandos que reconhece são muito simples. Podemos imaginar que o computador responde a ordens como "pega nesse número, divide-o por outro e guarda o resultado".

Um conjunto completo de comandos conhecidos é chamado de lista de instruções, por vezes abreviado para IL (do inglês, Instruction List). Os diferentes tipos de computadores podem variar em função do tamanho das suas IL, e as instruções podem ser completamente diferentes em diferentes modelos.

Atualmente, nenhum computador é capaz de criar uma nova linguagem. No entanto, isso pode mudar em breve. Por outro lado, as pessoas também utilizam uma série de línguas muito diferentes, mas estas línguas desenvolveram-se naturalmente. Além disso, ainda estão a evoluir. São criadas novas palavras todos os dias e as palavras antigas desaparecem. Estas línguas são chamadas linguagens naturais.

Podemos dizer que cada linguagem (de máquina ou natural, não importa) é constituída pelos seguintes elementos:

-

um alfabeto: um conjunto de símbolos utilizados para construir palavras de uma determinada linguagem (por exemplo, o alfabeto latino para inglês, o alfabeto cirílico para russo, o Kanji para japonês, etc.)

-

um lexis: (ou seja, um dicionário) um conjunto de palavras que a linguagem oferece aos seus utilizadores (por exemplo, a palavra "computador" vem do dicionário de língua inglesa, enquanto que "cmoptrue" não; a palavra "chat" está presente tanto nos dicionários de inglês como de francês, mas os seus significados são diferentes)

-

uma sintaxe: um conjunto de regras (formais ou informais, escritas ou sentidas intuitivamente) utilizadas para determinar se uma determinada sequência de palavras forma uma frase válida (por exemplo, "Eu sou uma pitão" é uma frase sintaticamente correta, enquanto "Eu uma pitão sou" não é)

-

semântica: um conjunto de regras que determinam se uma determinada frase faz sentido (por exemplo, "Comi um donut" faz sentido, mas "Um donut comeu-me" não faz)

O IL é, de facto, o alfabeto de uma linguagem de máquina. Este é o conjunto mais simples e primário de símbolos que podemos utilizar para dar comandos a um computador. É a língua materna do computador. Infelizmente, esta língua está muito longe de ser uma língua materna humana. Todos nós (tanto computadores como humanos) precisamos de algo mais, uma linguagem comum para computadores e humanos, ou uma ponte entre os dois mundos diferentes.

Precisamos de uma linguagem em que os humanos possam escrever os seus programas e uma linguagem que os computadores possam utilizar para executar os programas, uma linguagem que seja muito mais complexa do que a linguagem das máquinas e, no entanto, muito mais simples do que a linguagem natural.

Tais linguagens são muitas vezes chamadas linguagens de programação de alto nível. São pelo menos um pouco semelhantes aos naturais na medida em que utilizam símbolos, palavras e convenções legíveis para os seres humanos. Estas linguagens permitem aos seres humanos expressar comandos a computadores que são muito mais complexos do que os oferecidos pelas ILs. Um programa escrito numa linguagem de programação de alto nível é chamado source code, também conhecido como código-fonte (em contraste com o ee executado por computadores). Da mesma forma, o ficheiro que contém o source code chama-se source file, també conhecido como arquivo-fonte. A programação informática é o ato de compor os elementos da linguagem de programação selecionada pela ordem que provocará o efeito desejado. O efeito pode ser diferente em cada caso específico - depende da imaginação, conhecimento e experiência do programador.

É claro que tal composição tem de ser correta em muitos sentidos:

-

alfabeticamente - um programa precisa de ser escrito num guião reconhecível, tal como romano, cirílico, etc.

-

lexicamente - cada linguagem de programação tem o seu dicionário e é preciso dominá-lo; felizmente, é muito mais simples e menor do que o dicionário de qualquer língua natural;

-

sintaticamente - cada linguagem tem as suas regras, e estas devem ser obedecidas;

-

semanticamente - o programa tem de fazer sentido.

Infelizmente, um programador também pode cometer erros com cada um dos quatro sentidos acima referidos. Cada um deles pode fazer com que o programa se torne completamente inútil.

Vamos supor que tenha escrito um programa com sucesso. Como persuadir o computador a executá-lo? Tem de transformar o seu programa em linguagem de máquina. Felizmente, a tradução pode ser feita pelo próprio computador, tornando todo o processo rápido e eficiente.

Há duas formas diferentes de transformar um programa de uma linguagem de programação de alto nível em linguagem de máquina:

-

COMPILAÇÃO - o source program é traduzido uma vez (no entanto, este ato deve ser repetido sempre que modificar o source code) obtendo um ficheiro (por exemplo, um

ficheiro.exese o código se destinar a ser executado no MS Windows) contendo o machine code; agora pode distribuir o ficheiro por todo o mundo; o programa que executa esta tradução chama-se compilador ou tradutor; -

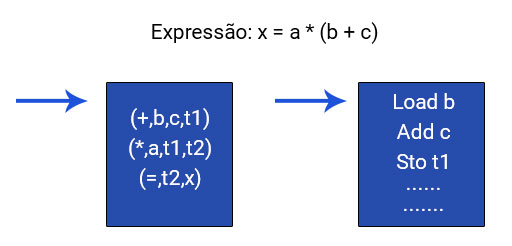

INTERPRETAÇÃO - você (ou qualquer utilizador do código) pode traduzir o source program cada vez que este tem de ser executado; o programa que executa este tipo de transformação chama-se intérprete ou interpretador, pois interpreta o código cada vez que se pretende executá-lo; também significa que não pode simplesmente distribuir o source code tal como está, porque o utilizador final também precisa do intérprete para o executar.

Aprenda mais: O interpretador converte para código de máquina, em tempo de execução. O compilador traduz o programa inteiro em código de máquina e o executa, gerando um arquivo que pode ser executado. O compilador gera um relatório de erros e o interpretador interrompe o processo na medida em que localiza um erro.

Devido a algumas razões muito fundamentais, uma linguagem de programação particular de alto nível foi concebida para se enquadrar numa destas duas categorias.

Há muito poucas linguagens que possam ser compiladas e interpretadas. Normalmente, uma linguagem de programação é projetada com este fator na mente dos seus construtores - será ela compilada ou interpretada?

Vamos assumir mais uma vez que escreveu um programa. Agora, existe como um ficheiro de computador (computer file): um programa de computador é na realidade um pedaço de texto, por isso o source code é normalmente colocado em ficheiros de texto (text files).

Nota: tem de ser texto puro, sem quaisquer decorações como diferentes fontes, cores, imagens embutidas ou outros suportes. Agora tem de invocar o intérprete e deixá-lo ler o seu source file.

O intérprete lê o source code de uma forma que é comum na cultura ocidental: de cima para baixo e da esquerda para a direita, porém há algumas exceções.

Em primeiro lugar, o intérprete verifica se todas as linhas subsequentes estão corretas (utilizando os quatro aspetos abordados anteriormente). Se o compilador encontrar um erro, termina o seu trabalho imediatamente. O único resultado, neste caso, é uma mensagem de erro.

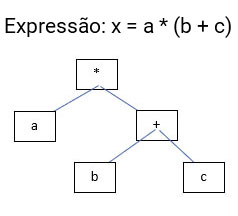

Em linguagem de máquina, iria corresponder:

Abstração é o processo de identificação das qualidades e/ou propriedades relevantes para o contexto que está sendo analisado e desprezando o que seja irrelevante. Um modelo é uma abstração da realidade.

Um programa de computador é um modelo, pois representa a solução de um problema em termos algorítmicos. Assim sendo, a abstração permeia toda a atividade de programação de computadores.

A linguagem de máquina foi a primeira a ser criada para a prática de programação. Trata-se da linguagem nativa do computador, a única que ele, de fato, compreende. Uma linguagem muito complicada para ser entendida pelas pessoas, em que um comando que soma 2 números, é formado por uma sequência de 1 e 0, muito difícil de ser memorizada, usada e, mais ainda, de ser entendida por terceiros.

As primeiras linguagens de programação, porém, não reconheciam o papel crucial que a abstração desempenha na programação. Por exemplo, no início da década de 1950, o único mecanismo de abstração fornecido pela linguagem de montagem, ou Assembly, em relação às linguagens de máquina eram os nomes simbólicos.

Você sabia? : O programador podia empregar termos relativamente autoexplicativos (nomes simbólicos) para nomear códigos de operação (ADD = soma, SUB = subtração, M = multiplicação e DIV = divisão) e posições de memória. A linguagem de montagem (Assembly) melhorou a vida do programador, porém obrigava-o a escrever 1 linha de código para cada instrução que a máquina deve executar, forçando-o a pensar como se fosse uma máquina.

Um pouco mais adiante, visando a aumentar o poder de abstração das linguagens de forma a permitir uma melhor performance dos programadores, surgem as linguagens de alto nível, próximas à linguagem humana e mais distantes das linguagens Assembly e de máquina.

A tabela, a seguir, exibe, à esquerda, um programa-fonte, escrito numa linguagem de alto nível, a linguagem Python. Ao centro, temos o código equivalente na linguagem Assembly para o sistema operacional Linux e, à direita, o respectivo código na linguagem de máquina, de um determinado processador. Observe:

| Linguagem Python | Linguagem Assembly | Linguagem de Máquina |

def swap(self, v, k):

temp = self.v[k];

self.v[k] =

self.v[k+1];

self.v[k+1]= temp;

|

swap:

Muli $2,$5,4

Add $2,$4,$2

Lw $15,0($2)

Lw $16,4($2)

Sw $16,0($2)

Sw $15,4($2)

Jr $31

|

00000000001111111111100000000001

00011111111000000111000011111101

11111000001100000111111110000000

10000000100000001000000010000000

00000000010000000001000000000010

00000000000000001111000010010101

00000000111000111111001111111111

|

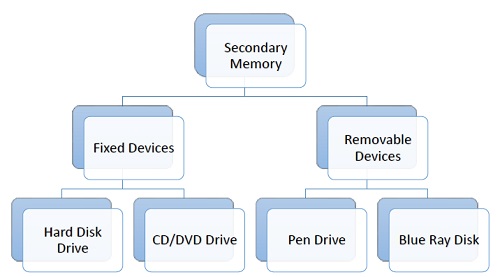

A imagem abaixo ilustra o conceito de abstração, em que a partir da linguagem de máquina, cria-se camadas (de abstração) para facilitar a vida do programador.

A imagem representa o crescimento do nível de abstração:

- É representado pelo hardware, conjunto de circuitos eletrônicos.

- É representado pela linguagem de máquina (1 e 0), única que o hardware entende.

- É representado pela linguagem Assembly (mneumônicos).

- É representado pelas linguagens de alto nível, próximas à língua do usuário e distantes da linguagem computacional. Python e Java são linguagens de programação representativas da classe LP de alto nível (LP = Linguagem de Programação).

Por que estudar linguagens de programação? O estudante e/ou programador que se dispuser a gastar seu tempo aprendendo linguagens de programação terá as seguintes vantagens:

- Maior capacidade de desenvolver soluções em termos de programas — compreender bem os conceitos de uma LP pode aumentar a habilidade dos programadores para pensar e estruturar a solução de um problema.

- Maior habilidade em programar numa linguagem, conhecendo melhor suas funcionalidades e implementações, ajuda para que o programador possa construir programas melhores e mais eficientes. Por exemplo, conhecendo como as LPs são implementadas, podemos entender melhor o contexto e decidir entre usar ou não a recursividade, que se mostra menos eficiente que soluções iterativas.

- Maiores chances de acerto na escolha da linguagem mais adequada ao tipo de problema em questão, quando se conhece os recursos e como a linguagem os implementa. Por exemplo, saber que a linguagem C não verifica, dinamicamente, os índices de acesso a posições de vetores pode ser decisivo para sua escolha em soluções que usem frequentemente acessos a vetores.

- Maior habilidade para aprender novas linguagens. Quem domina os conceitos da orientação a objeto, tem mais aptidão para aprender Python, C++, C# e Java.

- Amplo conhecimento dos recursos da LP reduz as limitações na programação.

- Maior probabilidade para projetar novas LP, aos que se interessarem por esse caminho profissional: participar de projetos de criação de linguagens de programação.

- Aumento da capacidade dos programadores em expressar ideias. Em geral, um programador tem expertise em poucas variedades de linguagens de programação, dependendo do seu nicho de trabalho. Isso, de certa forma, limita sua capacidade de pensar, pois ele fica restrito pelas estruturas de dados e controle que a(s) linguagem(ns) de seu dia a dia permitem. Conhecer uma variedade maior de recursos das linguagens de programação pode reduzir tais limitações, levando, ainda, os programadores a aumentar a diversidade de seus processos mentais.

Quanto maior for o leque de linguagens que um programador dominar e praticar, maiores as chances de conhecer e fazer uso das propriedades superlativas da(s) linguagem(ns) em questão.

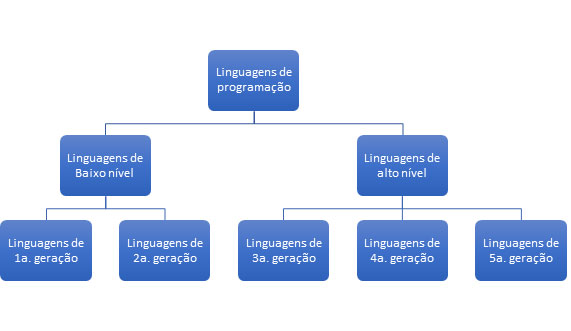

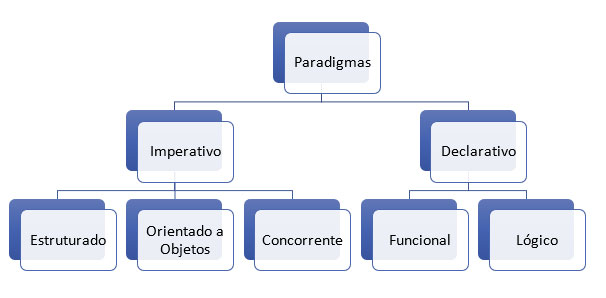

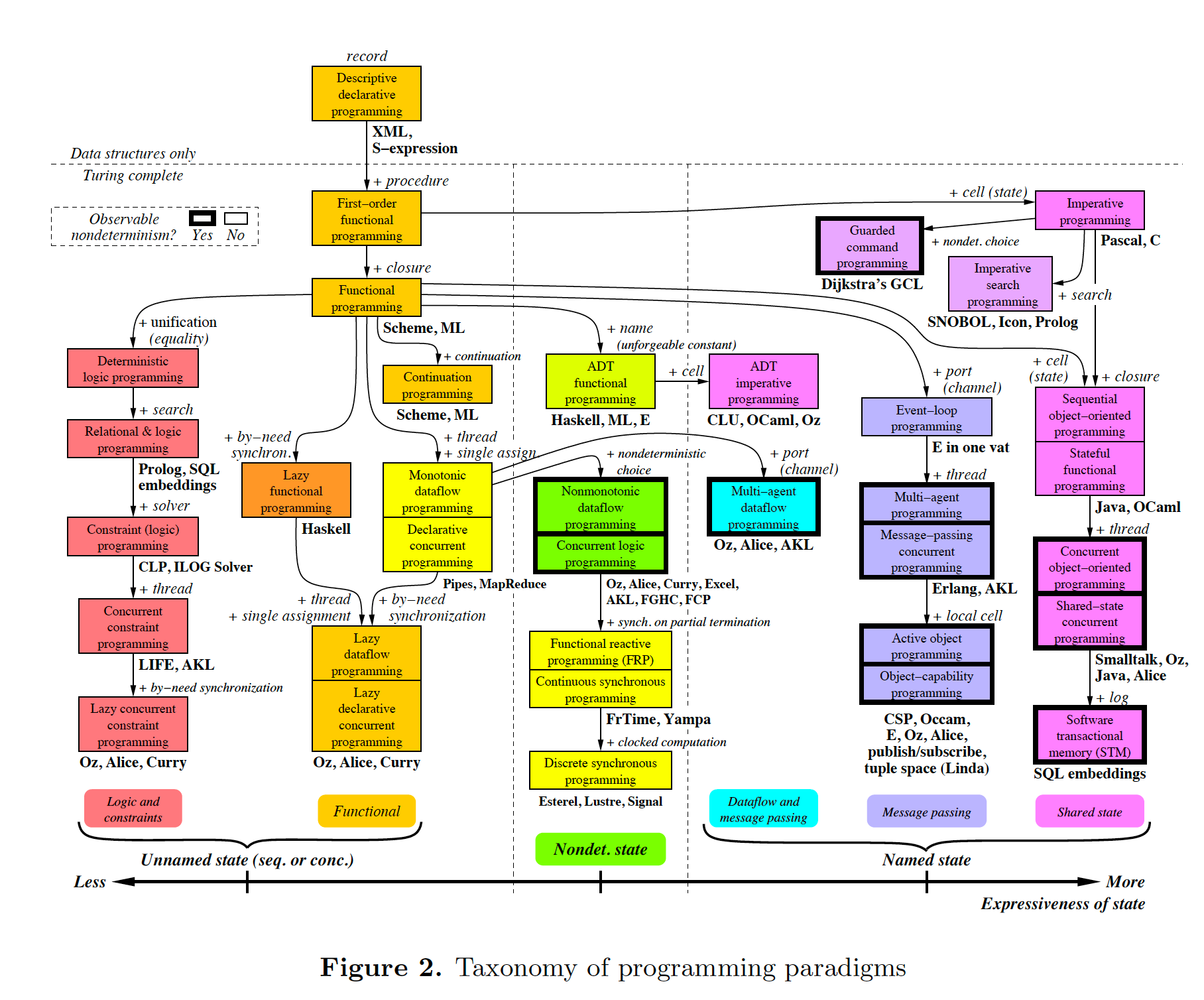

Ao longo dos anos, os autores têm criado diferentes classificações para as linguagens de programação, usando critérios diferenciados e agrupando-as sob diferentes perspectivas.

Veremos a seguir as classificações das linguagens por nível, por gerações e por paradigmas.

A classificação por nível considera a proximidade da linguagem de programação com as características da arquitetura do computador ou com a comunicação com o homem.

Linguagem de baixo nível são linguagens que se aproximam da linguagem de máquina, além da própria, que se comunicam diretamente com os componentes de hardware, como processador, memória e registradores. As linguagens de baixo nível estão relacionadas à arquitetura de um computador.

São linguagens escritas usando o conjunto de instruções do respectivo processador. Ou seja, cada processador diferente (ou família de processador, como os I3, I5 e I7 da Intel) tem um conjunto de instruções específicos (instructions set).

Abaixo, a imagem ilustra a representação de uma instrução em linguagem de máquina ou binária de um processador específico. A instrução tem palavras (unidade executada pelo processador) de 16 bits, sendo 4 bits para representar a instrução (código da instrução), 6 bits para representar cada operando.

Instrução em linguagem de máquina: Imagine, agora, uma sequência de 0 e 1 para que possamos dizer ao processador cada ação que deve ser realizada conforme ilustrado abaixo.

0001001010001111

1010010001000010

0010101110110111

0101010000000111

Era de fato muito complexa a programação na linguagem de máquina, a linguagem nativa dos processadores.

Essa complexidade motivou o desenvolvimento da linguagem Assembly, que deixava de ser a linguagem nativa dos processadores, mas usava das instruções reais dos processadores. Assim, a instrução na linguagem Assembly precisa ser convertida para o código equivalente em linguagem de máquina.

Exemplo: As três linhas de código na linguagem Assembly, abaixo, que move o numeral 2 para o registrador AX (linha 1), move o numeral 1 para o registrador BX (linha 2) e soma o conteúdo dos 2 registradores (linha 3).

MOV AX, 0002

MOV BX, 0001

ADD AX, BXNão chega a ser o ideal em termos de uma linguagem, que é ainda próxima da máquina, mas já foi um grande avanço em relação à memorização da sequência de 0 e 1 de uma instrução de máquina.

Linguagens de baixo nível: estão distantes da língua humana (escrita).

Linguagem de alto nível: No outro extremo das linguagens de baixo nível, estão as linguagens de alto nível, na medida em que se afastam da linguagem das máquinas e se aproximam da linguagem humana (no caso, a linguagem escrita e a grande maioria em Inglês).

Você sabia: Quem programa em uma linguagem de alto nível não precisa conhecer características dos componentes do hardware (processador, instruções e registradores). Isso é abstraído no pensamento computacional.

As instruções das linguagens de alto nível são bastante abstratas e não estão relacionadas à arquitetura do computador diretamente. As principais linguagens são:

Python, ASP, C, C++, C#, Pascal, Delphi, Java, Javascript, Go, Scala, Clojure, Lua, MATLAB, PHP e Ruby, dentre outras.

Abaixo, o mesmo código expresso acima, escrito em Assembly, porém usando variáveis, como abstração do armazenamento e codificado na linguagem Python.

def main(): num1 = 2 num2 = 1 soma = num1 + num2Abaixo, o mesmo código na linguagem C:

int num1, num2, soma; int main() { num1=2; num1=1; soma=num1+num2; }

Cada comando de uma linguagem de alto nível precisa ser convertido e equivalerá a mais de uma instrução primária do hardware. Isso significa que, numa linguagem de alto nível, o programador precisa escrever menos código para realizar as mesmas ações, além de outras vantagens, aumentando consideravelmente a sua eficiência ao programar.

Saiba mais: Há uma curiosidade: C e C++ são classificados por alguns autores como linguagem de médio nível, na medida que estão próximas da linguagem humana (linguagem de alto nível), mas também estão próximas da máquina (linguagem de baixo nível), pois possuem instruções que acessam diretamente memória e registradores. Inicialmente, a linguagem C foi criada para desenvolver o sistema operacional UNIX, que até então era escrito em Assembly.

Outro dado que merece ser comentado é que algumas pessoas consideram a existência de linguagens de altíssimo nível, como Python, Ruby e Elixir, por serem linguagens com uma enorme biblioteca de funções e que permitem a programação para iniciantes sem muito esforço de aprendizado.

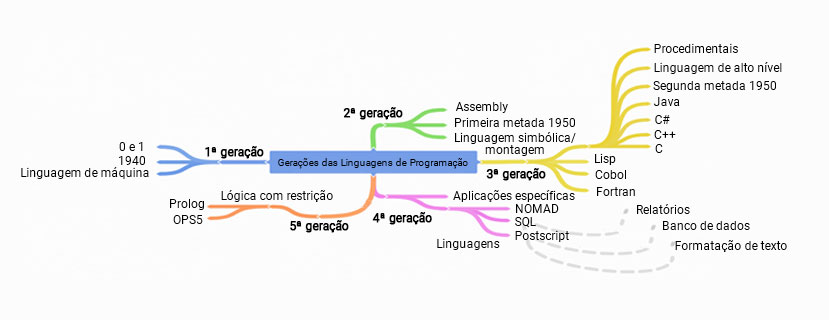

Outra forma de classificar as linguagens, amplamente difundida, é por gerações. Não há um consenso sobre as gerações, alguns consideram 5, outros 6. A cada geração, novos recursos facilitadores são embutidos nas respectivas linguagens.

-

A 1ª geração de linguagens é representa pela linguagem de máquina sendo baixo-nível, nativa dos processadores.

-

As linguagens de segunda geração são denominadas Assembly, sendo baixo-nível, e são traduzidas para a linguagem de máquina por um programa especial (montador), chamado Assembler. A partir dessa geração, toda linguagem vai precisar de um processo de conversão do código nela escrito, para o código em linguagem de máquina.

Acompanhe o exemplo abaixo para uma CPU abstrata. Considere a seguinte sequência de 3 instruções em linguagem Assembly:

| Código em Assembly | O que faz cada linha de código |

Mov #8, A |

Lê um valor da posição de memória 8 para o registrador A |

Mov #9, B |

Lê um valor da posição de memória 9 para o registrador B |

ADD A,B |

Soma os valores armazenados nos registradores A e B |

Em linguagem de máquina, depois de traduzidas pelo Assembler, as instruções poderiam ser representadas pelas seguintes sequências de palavras binárias:

| Código em Assembly | Código em linguagem de máquina |

Mov #8, A |

01000011 11001000 01100001 |

Mov #9, B |

01000011 11001001 01100010 |

ADD A,B |

01010100 01100001 01100010 |

Houve um aumento significativo no nível de abstração, mas parte da dificuldade permanece, pois o programador, além de necessitar memorizar os mneumônicos, precisa conhecer a arquitetura do computador como forma de endereçamento dos registradores e memória, além de outros aspectos.

- LINGUAGENS DE 3ª GERAÇÃO (LINGUAGENS PROCEDURAIS) [nível-médio] são as, também, linguagens de alto nível, de aplicação geral, em que uma única instrução em uma linguagem próxima a do homem pode corresponder a mais de uma instrução em linguagem de máquina.

Caracterizam-se pelo suporte a variáveis do tipo simples (caractere, inteiro, real e lógico) e estruturados (matrizes, vetores, registros), comandos condicionais, comando de iteração e programação modular (funções e procedimentos), estando alinhadas à programação estruturada.

O processo de conversão para a linguagem de máquina ficou mais complexo e ficaram a cargo dos interpretadores e tradutores. As primeiras linguagens de 3ª geração que foram apresentadas ao mercado são: Fortran, BASIC, COBOL, C, PASCAL, dentre outras.

Esta geração de linguagens apresenta as seguintes propriedades em comum:

- Armazenar tipos de dados estaticamente: simples, estruturados e enumerados.

- Alocar memória dinamicamente, através de ponteiros, que são posições de memória cujo conteúdo é outra posição de memória.

- Disponibilizar: estruturas de controle sequencial, condicional, repetição e desvio incondicional.

- Permitir a programação modular, com uso de parâmetros.

- Operadores: relacionais, lógicos e aritméticos.

- Ênfase em simplicidade e eficiência.

- LINGUAGENS DE 4ª GERAÇÃO (LINGUAGENS APLICATIVAS) são, também, linguagens de alto nível, com aplicação e objetivos bem específicos.

Enquanto as linguagens de 3ª geração são procedurais, ou seja, especifica-se passo a passo a solução do problema, as de 4ª geração são não procedurais. O programador especifica o que deseja fazer e não como deve ser feito.

O melhor exemplo de linguagens de 4ª geração é a SQL (Structured Query Language), utilizada para consulta à manipulação de banco de dados. PostScript e MATLAB são outros dois exemplos de linguagens de 4ª geração.

- LINGUAGENS DE 5ª GERAÇÃO (VOLTADAS À INTELIGÊNCIA ARTIFICIAL), alto-nível, são linguagens declarativas e não algorítmicas. Exemplos: Lisp e Prolog. As linguagens de 5ª geração são usadas para desenvolvimento de sistemas especialistas (área da IA), de sistemas de reconhecimento de voz e machine learning.

A imagem a seguir ilustra as características de cada geração.

Alguns autores classificam a 6ª geração, como uma evolução da 5ª, em que prevalecem as aplicações de redes neurais, uma outra vertente da Inteligência Artificial.

Resumindo:A abstração traz facilidades ao programador que cada vez menos precisa conhecer o ambiente onde a linguagem opera (composto por sistema operacional e hardware); Um comando em uma linguagem de alto nível faz mais que uma operação primária do hardware.

Considerando as diversas linguagens de programação existentes hoje no mercado, atendendo a propósito comuns, vamos destacar neste módulo os domínios da programação, que são seis:

- Aplicações científicas

- Aplicações comerciais

- Aplicações com Inteligência Artificial

- Programação de sistemas

- Programação para web

- Programação mobile

Na sequência, apresentaremos critérios que podem ser usados para avaliação de linguagens de programação, claro, dentro do mesmo domínio de programação.

O computador tem sido usado para diversos fins, na ciência, nas forças armadas, nas empresas públicas e privadas, pelos profissionais liberais, pelas pessoas em seus lazeres e onde mais possa ser aplicado. Seu uso vai desde controlar robôs que fazem a montagem de automóveis em suas linhas de montagem até jogos digitais. Em função desse uso adverso, surgiram linguagens de programação com diferentes objetivos. A seguir, discutiremos as principais áreas e as respectivas linguagens de programação em destaque.

APLICAÇÕES CIENTÍFICAS (MÁQUINAS DE CALCULAR COM ALTA PRECISÃO), o primeiro computador, o ENIAC, foi desenvolvido por 3 anos e ficou pronto no ano de 1946. Sua principal finalidade eram cálculos balísticos. Os computadores seguintes, nas décadas de 1940 e 1950, também focaram em cálculos científicos complexos.

As linguagens de programação nessa época eram a linguagem de máquina e Assembly. Na década de 1960 surgem as primeiras linguagens de programação de alto nível, com destaque para Fortran (iniciais de FORmula TRANslator) e posteriormente para ALGOL60. As principais características dessas linguagens eram:

- Estruturas de dados simples.

- Alto volume de cálculos com aritmética de ponto flutuante (precisão).

- Preocupação com a eficiência, pois sucederam a linguagem Assembly.

APLICAÇÕES COMERCIAIS, a segunda onda de aplicativos foi para suprir as demandas das empresas a partir de meados da década de 1950. Em 1960, surge a linguagem que seria o ícone das aplicações comerciais de computadores de grande porte, naquele momento, o COBOL. As linguagens de programação que apoiaram o crescimento das aplicações comerciais têm como características:

- Facilidade para produzir relatórios, fundamentais nos controles das operações contábeis, bancárias, estoque e financeiras (primeiros focos da época).

- Precisão com números decimais e ponto flutuante, para representar as altas cifras das grandes empresas, as primeiras a investirem nessas aplicações.

- Capacidade de especificar operações aritméticas comerciais.

Cabe destacar que as linguagens destinadas a aplicações comerciais ganham força com a microcomputação a partir dos anos 1980, levando as aplicações comerciais aos médios e pequenos empresários.

APLICAÇÕES COM INTELIGÊNCIA ARTIFICIAL, as linguagens que sustentam o desenvolvimento de aplicações apoiadas na Inteligência Artificial (IA) ganham força nos dias de hoje.

A grande ruptura no pensamento computacional é que as linguagens que apoiam a IA usam a computação simbólica e não numérica, como a maioria das linguagens da época. Em 1959, surge a linguagem Lisp, primeira linguagem projetada para apoio à computação simbólica, primeira referência da computação funcional. Prolog, criada em 1977, foi a primeira linguagem para apoio da computação lógica, essência dos sistemas especialistas (sistemas que usam IA para simular o comportamento humano).

PROGRAMAÇÃO DE SISTEMAS, a programação de sistemas cabe a linguagens de programação que tenham comandos e estruturas para acessar, diretamente, o hardware. Tais linguagens são usadas para desenvolver softwares básicos, como sistemas operacionais, tradutores e interpretadores de linguagens de programação. Antes de surgir a linguagem C, usada para desenvolver o sistema operacional Linux, Assembly era a linguagem usada para esse fim. A linguagem C++ também é usada com essa finalidade.

PROGRAMAÇÃO PARA WEB, com o crescimento da internet e tecnologias adjacentes, o uso dos sistemas se desloca do ambiente desktop (domínio dos anos 1980 e 1990) para o ambiente Web.

No contexto de programação para Web, temos 2 diferentes ambientes de desenvolvimento: a camada de apresentação, que roda no navegador (lado cliente) e a camada de lógica do negócio, que roda nos servidores web (lado servidor), juntamente com a camada de persistência, considerando o modelo de desenvolvimento em 3 camadas (apresentação, lógica do negócio e persistência de dados).

Para a camada de apresentação, usa-se as linguagens HTML (linguagem de marcação) e CSS (usada em conjunto com HTML para definir a apresentação da página web), além de JavaScript (programação de scripts), no lado cliente (navegadores).

Para o desenvolvimento das camadas de lógica do negócio, as principais LP são: C#, PHP, ASP, .NET, Java, Ruby e Python.

PROGRAMAÇÃO MOBILE, considerando que hoje em dia, grande parte da população, no Brasil e no Mundo, tem acesso à internet pelo celular, cresceu vertiginosamente a quantidade de apps (aplicativos) para uso de aplicações via celular. Os apps, na verdade, são interfaces que rodam no lado cliente.

As principais (não todas) linguagens que apoiam o desenvolvimento de apps para o mundo mobile, oficialmente indicadas por seus fabricantes, são:

- Android: Java e Kotlin.

- iOS: Swift (oficial da Apple) e Objective-C (código nativo para iOS).

- Windows: C#, Visual Basic (VB), C++, HTML, CSS, JavaScript e Java.

O desenvolvimento de APP para iOS é baseado numa IDE chamada Xcode que permite o desenvolvimento de APP em várias linguagens, como: C, C++, Java e Python, mas oficialmente orienta o Swift e Objective-C.

A Google, por sua vez, tem por base o Android SDK, orienta a usar as linguagens Kotlin, Java e C++, mas as linguagens Python, Shell script, Basic4Android, LiveCode (para iOS e Windows também), App Inventor (não necessita conhecer programação) e Unity (motor para games) e GO, também são usadas para desenvolver app para Android.

No contexto de desenvolvimento de APP para Windows, foi lançado no Windows 8.1 e atualizado para atender também ao Windows 10, o App Studio, que permite a qualquer pessoa criar em poucos passos um app Windows e publicá-lo na loja.

Importante destacar que hoje existem plataformas de desenvolvimento mobile conectadas a nuvem que fomentam o desenvolvimento de apps nativos para iOS, Android e Windows.

Segundo Sebesta (2018) são quatro grandes critérios para avaliação das linguagens de programação, dentro de um mesmo domínio de programação. Cada critério é influenciado por algumas características da linguagem.

Legibilidade: Um dos critérios mais relevantes é a “facilidade com que os programas podem ser lidos e entendidos” pelas pessoas que não necessariamente participaram do desenvolvimento.

Facilidade de escrita: O quão facilmente uma linguagem pode ser usada para desenvolver programas para o domínio do problema escolhido.

Confiabilidade: Um programa é dito confiável se ele se comporta conforme a sua especificação, repetidas vezes.

Custo: O custo final de uma linguagem de programação é em função de muitas de suas propriedades e características.

A tabela a seguir exibe as características da linguagem que influenciam cada um dos três principais fatores de avaliação de linguagens.

| Critérios | |||

| Características | Legibilidade | Facilidade escrita | Confiabilidade |

| Simplicidade | xxxxxxxxxxxx | xxxxxxxxxxxx | xxxxxxxxxxxx |

| Ortogonalidade | xxxxxxxxxxxxxx | xxxxxxxxxxxxxx | xxxxxxxxxxxxxx |

| Estruturas de controle | xxxxxxxxxxxxxxxxx | xxxxxxxxxxxxxxxxx | xxxxxxxxxxxxxxxxx |

| Tipos de dados | xxxxxxxxxxxxxx | xxxxxxxxxxxxxx | xxxxxxxxxxxxxx |

| Projeto de sintaxe | xxxxxxxxxxxxxxxxxx | xxxxxxxxxxxxxxxxxx | xxxxxxxxxxxxxxxxxx |

| Suporte para abstração | xxxxxxxxxxxxxxxxxx | xxxxxxxxxxxxxxxxxx | |

| Expressividade | xxxxxxxxxxxxxxxxxx | xxxxxxxxxxxxxxxxxx | |

| Verificação de tipos | xxxxxxxxxxxxxxxxxx | ||

| Tratamento de exceções | xxxxxxxxxxxxxxxxxx | ||

| Aliasing | xxxxxxxxxxxxxxxxxx |

Características x Critérios de Avaliação de LPs

Legibilidade: Um dos critérios mais relevantes para avaliar uma linguagem de programação diz respeito à capacidade com que os programas podem ser lidos e entendidos pela sintaxe e construção da linguagem, sem considerar as possíveis influências da má programação.

As características que influenciam a legibilidade de uma linguagem de programação são:

SIMPLICIDADE: Quanto mais simples for uma linguagem, melhor será a legibilidade do código por ela produzido. Uma linguagem com número elevado de construções básicas é mais difícil de ser aprendida do que uma que tenha poucas. Tende a ser subutilizada.

Uma segunda característica que afeta negativamente a legibilidade é a multiplicidade de recursos. Por exemplo, em Python, o programador pode incrementar uma variável, de duas formas distintas:

cont = cont + 1cont += 1

Nas linguagens C e Java, ainda podemos usar para incrementar variáveis as seguintes estruturas: ++cont e cont++.

Muita simplicidade pode tornar menos legíveis os códigos escritos. Na linguagem Assembly, a maioria das sentenças são simples, porém não são altamente legíveis devido à ausência de estruturas de controle.

Uma terceira característica que afeta negativamente a legibilidade é a sobrecarga de operadores, como por exemplo o +, usado para somar inteiros, reais, concatenar cadeias de caracteres (strings), somar vetores (Arrays), dentre outras construções permitidas pela linguagem.

A ortogonalidade de uma linguagem refere-se a um conjunto relativamente pequeno de construções primitivas que pode ser combinado em um número, também, pequeno de maneiras para construir as estruturas de controle e de dados de uma linguagem de programação.

Em outras palavras: possibilidade de combinar, entre si, sem restrições, as construções básicas da linguagem para construir estruturas de dados e de controle.

- Boa ortogonalidade: Permitir, por exemplo, que haja um vetor, cujos elementos sejam do tipo registro (estrutura heterogênea).

- Má ortogonalidade: Não permitir que um vetor seja passado como argumento para uma rotina (procedimento ou função). Ou que uma função não possa retornar um vetor. Uma linguagem ortogonal tende a ser mais fácil de aprender e tem menos exceções.

A falta de ortogonalidade leva a muitas exceções às regras da linguagem e ao excesso, o contrário (menos exceções às regras). Menos exceções implicam um maior grau de regularidade no projeto da linguagem, tornando-a mais fácil de ler, entender e aprender.

INSTRUÇÕES DE CONTROLE: Instruções como Goto (desvio incondicional) limitam a legibilidade dos programas, pois essa instrução pode levar o controle do código a qualquer ponto do programa, limitando o entendimento e, consequentemente, a legibilidade do código escrito na linguagem. As linguagens modernas não implementam desvio incondicional, assim sendo, o projeto de estruturas de controle é menos relevante na legibilidade do que anos atrás, quando surgiram as primeiras linguagens de alto nível.

A facilidade oferecida pela linguagem para definir tipos e estruturas de dados é outra propriedade que aumenta a legibilidade do código escrito. Por exemplo, uma linguagem que permita definir registros e vetores, mas não permite que um vetor tenha registros como seus elementos, terá a legibilidade afetada.

A linguagem C não possui o tipo de dado lógico ou booleano. Muitas vezes, usa-se variáveis inteiras, permitindo apenas que receba os valores 0 e 1 para conteúdo, simulando o tipo booleano. Por exemplo, para localizar um elemento em uma das posições de um vetor, usa-se uma variável lógica se a linguagem permitir e, assim, teríamos a instrução achou=false em determinado trecho de código. Em outra linguagem que não permita o tipo de dado lógico, a instrução poderia ser achou=0, em que achou seria uma variável inteira. Qual das duas sentenças é mais clara a quem lê o código? A primeira, não é? achou=false.

A sintaxe tem efeito sobre a legibilidade. Um exemplo é a restrição do tamanho (quantidade de caracteres) para um identificador (tipo, variável, constante, rotina – procedimento e função), impedindo que recebam nomes significativos sobre sua utilidade. Na linguagem Fortran, o nome do identificador pode ser até 6 caracteres.

Outra propriedade de sintaxe que afeta a legibilidade é o uso de palavras reservadas da linguagem. Por exemplo, em Pascal, os blocos de instrução são iniciados e encerrados com BEGIN-END, respectivamente. A linguagem C usa chaves para iniciar e encerrar blocos de instruções. Já a linguagem Python usa a endentação obrigatória para marcar blocos de comandos, aumentando a legibilidade, naturalmente.

A facilidade de escrita (redigibilidade) é a medida do quão fácil a linguagem permite criar programas para um domínio da aplicação.

A maioria das características que afeta a legibilidade também afeta a facilidade de escrita, pois se a escrita do código não flui, haverá dificuldade para quem for ler o código.

As características que influenciam na facilidade de escrita são:

SIMPLICIDADE E ORTOGONALIDADE: Quanto mais simples e ortogonal for a linguagem, melhor sua facilidade para escrever programas. O ideal são linguagens com poucas construções primitivas.

Imagina que uma linguagem de programação possui grande número de construções. Alguns programadores podem não usar todas, deixando de lado, eventualmente, as mais eficientes e elegantes.

Uma linguagem de programação com boa expressividade contribui para o aumento da facilidade de escrita dos códigos.

- Assembly: Baixa expressividade.

- Pascal e C, boa expressividade: Ricas estruturas de controle. Exemplo: o comando

FORmais adequado queWHILEeREPEATpara representar lações com número fixo de vezes. Da mesma forma que o C, em que oFORé mais indicado que oWHILEeDO-WHILE. Na linguagem Python, ocorre o mesmo entre os comandosFOReWHILE. - Na linguagem C, temos construções diversas para incremento de variável:

i++é mais simples e conveniente de usar do quei=i+1, sendoi, uma variável inteira. Uma linguagem expressiva possibilita escrever linhas de código de uma forma mais conveniente ao invés de deselegante.

SUPORTE PARA A ABSTRAÇÃO: O grau de abstração em uma linguagem é uma propriedade fundamental para aumentar a facilidade de escrita. Abstração pode ser de:

- Processos, como o conceito de subprograma.

- Dados, como uma árvore ou lista simplesmente encadeada.

Confiabilidade: Dizemos que um programa é confiável se ele se comportar conforme sua especificação, sob todas as condições, todas as vezes em que for executado.

Abaixo, alguns recursos das linguagens que exercem efeito sobre a confiabilidade de programas.

VERIFICAÇÃO DE TIPOS: Significa verificar, em tempo de compilação ou execução, se existem erros de tipo. Por exemplo, atribuir um valor booleano a uma variável do tipo inteira, vai resultar em erro. As linguagens fortemente tipadas, em tempo de compilação, como Python e Java, tendem a ser mais confiáveis, pois apenas valores restritos aos tipos de dados declarados poderão ser atribuídos e diminuem os erros em tempo de execução. Linguagens, como C, em que não é verificado se o tipo de dado do argumento é compatível com o parâmetro, em tempo de compilação, podem gerar erros durante a execução, afetando a confiabilidade. A verificação de tipos em tempo de compilação é desejável, já em tempo de execução é dispendiosa (mais lenta e requer mais memória), e mais flexível (menos tipada).

O tratamento de exceção em uma linguagem de programação garante a correta execução, aumentando a confiabilidade. As linguagens Python, C++ e Java possuem boa capacidade de tratar exceções, ao contrário da linguagem C. A linguagem deve permitir a identificação de eventos indesejáveis (estouro de memória, busca de elemento inexistente, overflow etc.) e especificar respostas adequadas a cada evento. O comportamento do programa torna-se previsível com a possibilidade de tratamento das exceções, o que tende a aumentar a confiabilidade do código escrito na linguagem de programação.

Aliasing (APELIDOS) é o fato de ter dois ou mais nomes, referenciando a mesma célula de memória, o que é um recurso perigoso e afeta a confiabilidade. Restringir Aliasing é prover confiabilidade aos programas.

Ambos influenciam a confiabilidade. A legibilidade afeta tanto na fase de codificação como na fase de manutenção. Programas de difícil leitura são difíceis de serem escritos também.

Uma linguagem com boa legibilidade e facilidade de escrita gera códigos claros, que tendem a aumentar a confiabilidade.

O custo de uma linguagem de programação varia em função das seguintes despesas: de treinamento, de escrita do programa, do compilador, de execução do programa, de implementação da linguagem e o de manutenção do código.

| Custo de | Características |

| Treinamento | Custo de Treinamento para programadores varia em função da expertise do programador, simplicidade e ortogonalidade da linguagem; F (simplicidade de escrita, ortogonalidade, experiência do programador). |

| Escrever programa | Custo para escrever programas na linguagem varia em função da facilidade de escrita. F(Facilidade de escrita). |

| Compilar o programa | Esse custo varia em função do custo de aquisição do compilador, hoje minimizado, em linguagens open source, como é o caso do Python. F (custo de aquisição do compilador). |

| Executar o programa | Custo para executar programas, varia em função do projeto da linguagem. F (Projeto da linguagem). |

| Implementar a linguagem | A popularidade da LP vai depender de um econômico sistema de implementação. Por exemplo, Python e Java possuem compiladores e interpretadores gratuitos. |

| Confiabilidade | O custo da má confiabilidade: se um sistema crítico falhar, o custo será elevado. Exemplos: sistema de controle de consumo de água e sistemas de usina nuclear. |

| Manutenção | Custo de manutenção: depende de vários fatores, mas principalmente da legibilidade, já que a tendência é que a manutenção seja dada por pessoas que não participaram do desenvolvimento do software. |

Os custos em treinamento e de escrever o programa podem ser minimizados se a linguagem oferecer bom ambiente de programação.

Python é uma linguagem com alta legibilidade, facilidade de escrita, além de confiável. Seu custo não é elevado, pois além de ser open source, é fácil de aprender.

Warning

ATENÇÃO! Existem outros critérios, como por exemplo a portabilidade ou a capacidade que os programas têm de rodarem em ambientes diferentes (sistema operacional e hardware), o que é altamente desejável. A reusabilidade, ou seja, o quanto um código pode ser reutilizado em outros programas ou sistemas aumenta o nível de produtividade da linguagem. Além da facilidade de aprendizado, que é fortemente afetada pela legibilidade e facilidade de escrita.

Como funcionam C++, Java e Python? O diagrama mostra como a compilação e a execução funcionam:

Linguagens compiladas são compiladas em código de máquina pelo compilador. O código de máquina pode ser executado diretamente pela CPU posteriormente. Exemplos: C, C++, Go.